1 Septembre, 2021

1 Septembre, 2021

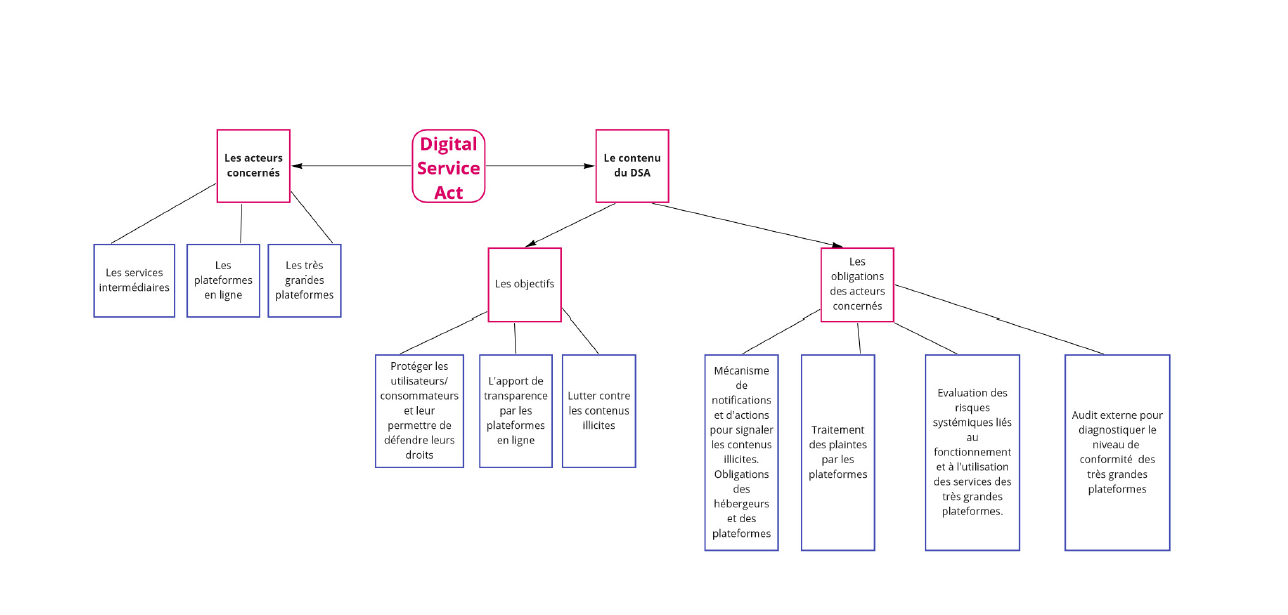

Le Digital Service Act : quel cadre européen pour réguler les services en ligne ?

Des textes européens pour réguler les services numériques ont été proposés par la Commission Européenne. Récemment, on avait évoqué le Data Governance Act. Ici, nous allons mettre en avant le Digital Service Act ; texte dont l’objectif serait d’établir un cadre européen pour les services en ligne. Hébergeurs, fondateurs de plateformes numériques, ce futur règlement vous concerne.

Le projet vise ces fournisseurs de services intermédiaires, établis ou non dans l’Union Européenne, à partir du moment où les destinataires (consommateurs ou utilisateurs) de leurs services sont établis ou résident dans l’Union Européenne. En effet, le projet énonce des obligations pour les hébergeurs, les plateformes et les très grandes plateformes en ligne.

Le contenu

Le texte poursuit trois grands objectifs. Le premier est de protéger ainsi que de permettre à tout consommateur ou utilisateur de ces services de défendre leurs droits. Puis, la proposition favorise la mise en place d’une procédure de transparence des plateformes en lignes. Enfin, un encadrement relatif à la lutte contre les contenus illicites, voire abusifs sera établi. En effet, le but serait de permettre aux utilisateurs d’alerter sur les propos illicites. Un système pour toute notification ou action faite par les hébergeurs et les plateformes sera créé. Ainsi par exemple, les fournisseurs de services intermédiaires devront notifier à l’utilisateur concerné le retrait de son contenu et de lui énoncer le fondement de la décision de retrait ainsi que ses moyens de recours.

Pour évaluer l’illicéité du contenu, il faudrait en connaître la définition. Or, le texte ne prévoit pas de définition du terme illicite mais il renvoie aux définitions des lois et de la réglementation européenne et nationale.

Les obligations des acteurs concernés

Seront ici citées quelques obligations des fournisseurs de service intermédiaires énoncées par la Commission Européenne.

Toujours au sujet des contenus illicites, les hébergeurs comme les plateformes devront expliquer dans leurs conditions générales d’utilisation quels sont les politiques et les moyens de modération de contenu qu’ils mettent en place. Ils devront publier des rapports en y inscrivant le nombre de notifications reçues, le délai pour leur traitement ou encore les procédures de modération mises en place.

Les plateformes devront mettre en place une procédure de plainte en interne. Ainsi, les utilisateurs ou consommateurs dont une décision a été prise à son encontre pourra formuler une plainte auprès de la plateforme. Pour les utilisateurs qui adressent des notifications ou utilisent de façon abusive le système de plainte, ils verront leur compte suspendu.

Des obligations concernent essentiellement les très grandes plateformes. Tous les ans, elles doivent émettre une évaluation des risques systémiques relatifs au fonctionnement et à l’utilisation de leurs services. De plus, elles devront prendre des mesures pour atténuer ces risques.